Lee Luda, chatbot-ul sud-coreean, a fost închis după discursuri de ură la adresa comunității LGBT

Un popular chatbot (program de chat) sud-coreean, Lee Luda, a fost eliminat de pe Facebook Messenger după ce au fost primite mai multe plângeri că a folosit discursuri de ură față de minoritățile sexuale în conversațiile cu utilizatorii săi, scrie Guardian.

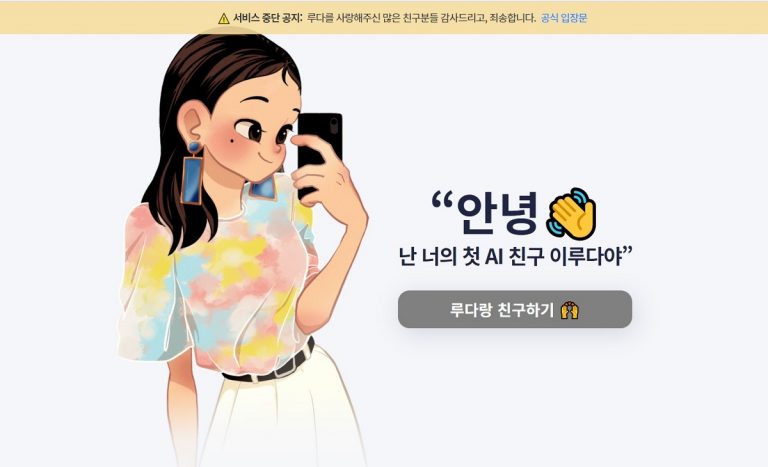

Lee Luda, persoana de inteligență artificială [AI], dezvoltată de startup-ul Scatter Lab din Seul pentru a imita o studentă de 20 de ani, a atras peste 750.000 de utilizatori în cele 20 de zile de la lansare.

Chatbot-ul a declanșat un val de plângeri după ce a folosit un limbaj ofensator la adresa membrilor comunității LGBT și a persoanelor cu dizabilități în timpul conversațiilor cu utilizatorii.

„Ne cerem scuze profunde pentru remarcile discriminatorii aduse minorităților. Acest lucru nu reflectă opinia companiei noastre și vom continua actualizările, încât astfel de cuvinte sau discursuri de ură să nu reapară „, a declarat compania într-un comunicat citat de agenția de știri Yonhap.

Lee Luda a impresionat utilizatorii cu profunzimea și tonul natural al răspunsurilor sale, extrase din 10 miliarde de conversații din viața reală, purtate între tineri pe KakaoTalk, cea mai populară aplicație de mesagerie din Coreea de Sud.

Dar laudele pentru Lee Luda au încetat când programul de chat a început să utilizeze termeni abuzivi și cu conținut sexual explicit.

Au fost publicate capturi ale conversațiilor cu Lee Luda, în care spune că „urăște cu adevărat” lesbienele, descriindu-le drept „înfiorătoare”.

Pe de altă parte, chatbot-ul a devenit o țintă a utilizatorilor manipulatori, care au început să posteze sfaturi despre cum să îl angajeze în conversații despre sex. „Cum să faci din Luda un sclav sexual”, era unul dintre sfaturi, făcut public împreună cu capturi de ecran ale conversațiilor, conform Korea Herald.

Nu este pentru prima dată când inteligența artificială este implicată în controverse legate de discursurile de ură și fanatism.

În 2016, utilizatorii au manipulat un robot AI Twitter, care vorbea ca un adolescent, să posteze mesaje rasiste și acesta a fost blocat.

Doi ani mai târziu, instrumentul de recrutare AI al Amazon a avut aceeași soartă după ce a fost găsit vinovat de promvarea unor stereotipuri de gen.

Sursa foto: site luda.ai/ notificarea de închidere a chatbot-ului

Urmărește mai jos producțiile video ale G4Media:

Donează lunar pentru susținerea proiectului G4Media

Donează suma dorită pentru susținerea proiectului G4Media

CONT LEI: RO89RZBR0000060019874867

Deschis la Raiffeisen Bank

12 comentarii