Următorul nivel al fake-news-ului. Cum afectează fenomenul deepfake viitorul politicii

Deepfake-urile sunt înregistrări audio sau video suprarealiste, create cu ajutorul inteligenței artificiale (AI), în care cineva apare spunând sau făcând ceva ce, de fapt, nu a spus sau făcut. Cuvântul deepfake este o combinație între deep learning, un tip de algoritm AI, și fake, se arată într-un material publicat de Carnegie Endowment for International Peace.

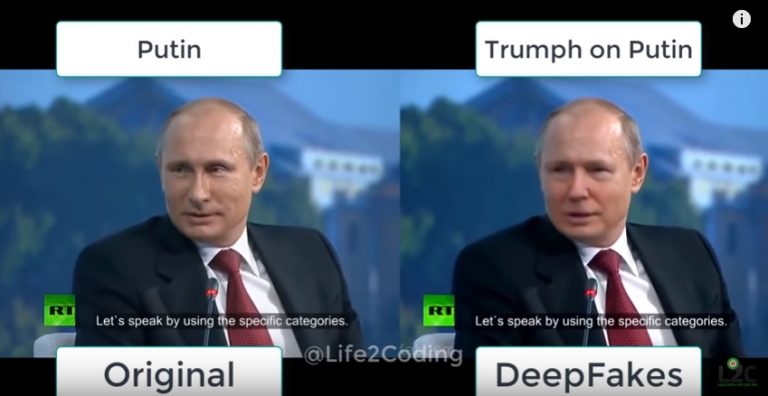

Algoritmul care stă la baza deepfake-ului suprapune mișcările și cuvintele unei persoane peste cele ale altei persoane. De exemplu, dacă luăm o înregistrare cu două persoane, un interpret și o țintă, algoritmul generează un nou video sintetic în care persoana țintă se mișcă și vorbește ca interpretul. Cu cât algoritmul învață din mai multe înregistrări video, cu atât video-ul generat este mai realist.

Până acum, tehnicile de modificare a înregistrărilor video erau numai la îndemâna specialiștilor. Dar astăzi, inteligența artificială le permite celor care nu sunt specialiști să creeze falsuri pe care oamenii le vor interpreta drept reale. Deși algoritmii deep learning sunt dificili, există platforme care permit utilizatorilor fără cunoștințe avansate în domeniul inteligenței artificiale să îi folosească pentru a crea deepfake-uri. Aceste platforme permit oricui are acces la internet și fotografii cu fețele unor persoane să creeze un deepfake. Există, de asemenea, tutoriale pentru utilizatorii care vor să învețe pas cu pas cum funcționează aceste platforme.

Iar partea cea mai rea este că deepfake-urile sunt greu de detectat. Ele nu au niciun semn evident sau consistent. Experții pot detecta un deepfake numai dacă sunt atenți la indiciile subtile și greu de imitat, cum ar felul în care cineva clipește.

Deepfake-urile pot incita la violență politică, pot sabota alegerile electorale sau pot zdruncina relațiile diplomatice. Anul trecut, de pildă, un partid politic din Belgia a publicat pe Facebook un deepfake în care apărea președintele Donald Trump criticând poziția Belgiei cu privire la schimbările climatice. Înregistrarea video nesofisticată a fost relativ ușor de demontat, dar aceasta încă provoacă comentarii ultragiate în mediul online, comentarii în care președintele american este acuzat că se implică în politica internă a Belgiei.

Deepfake-ul creat de cercetătorii germani, în care apăreau președintele rus Vladimir Putin, fostul președinte american George W. Bush și președintele Trump a demonstrat potențialul distructiv al deepfake-urilor. Într-un video realizat în timpul studiului, un ecran împărțit în două arăta un cercetător și un politician. În timp ce cercetătorul vorbea și își schimba expresia facială, politicianul din imagine îi urma gesturile și îi imita cuvintele.

Uniunea Europeană a făcut pași importanți în lupta împotriva tuturor formelor deliberate de dezinformare, inclusiv deepfake-urile.

Anul trecut, Bruxeles-ul a publicat o strategie pentru combaterea dezinformării, care include câteva sfaturi pentru lupta cu deepfake-urile. Linia generală pentru combaterea tuturor formelor de dezinformare este angajamentul public care face mai ușor de contracarat informațiile false. Dacă oamenii menționează sursa informației, cum a fost aceasta produsă și dacă este de încredere, atunci fenomenul dezinformării ar putea fi mai ușor de combătut. Strategia Uniunii Europene solicită, de asemenea, crearea unei rețele europene independente de persoane care să verifice faptele pentru a analiza sursele și a procesa conținutul informațiilor.

Până acum, deepfake-urile nu au incitat la violență politică și nu au sabotat alegerile electorale. Dar tehnologia necesară pentru a face aceasta este acum disponibilă. Iar aceasta înseamnă există o ferestră de oportunitate – îngustă, totuși – prin care statele să se protejeze împotriva amenințărilor potențiale ale deepfake-urilor înainte ca o catastrofă să fie declanșată.

Sursă foto: captură YouTube

NOTĂ Robert Ciobanu este bursier al Fundației Konrad Adenauer în parteneriat cu G4Media.ro

Articol publicat în cadrul unui proiect comun G4Media.ro – IPP. #StopDezinformare

Urmărește mai jos producțiile video ale G4Media:

Donează lunar pentru susținerea proiectului G4Media

Donează suma dorită pentru susținerea proiectului G4Media

CONT LEI: RO89RZBR0000060019874867

Deschis la Raiffeisen Bank

7 comentarii